Entre nos nossos canais do Telegram e WhatsApp para notícias em primeira mão.

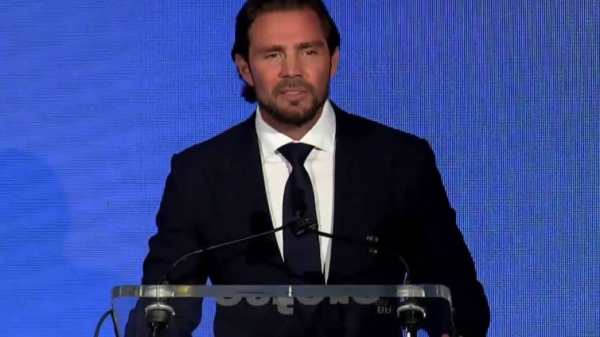

Em meio à popularização dos assistentes de inteligência artificial, uma nova preocupação surge para os usuários dessas plataformas: as conversas mantidas com o ChatGPT podem ser utilizadas como prova em processos judiciais. O alerta foi feito por Sam Altman, diretor-executivo da OpenAI, em entrevista ao podcast This Past Weekend, comandado por Theo Von.

Segundo Altman, embora a empresa valorize a privacidade dos usuários, há situações em que pode ser obrigada a fornecer registros de diálogos à Justiça. “Se você compartilhar suas informações mais sensíveis no chat e, posteriormente, houver uma ação judicial, poderíamos ser obrigados a entregar esses dados”, afirmou.

A OpenAI processa mais de 2,5 bilhões de interações por dia e informa, em sua política de privacidade, que coleta e armazena dados dos usuários — incluindo o conteúdo das conversas — para cumprir obrigações legais. Com isso, a empresa pode ser obrigada a entregar essas informações em caso de determinação judicial, como já ocorreu com outras gigantes da tecnologia.

Um dos precedentes mais conhecidos envolve a Amazon. Em 2015, durante a investigação do assassinato de Victor Collins, no estado norte-americano do Arkansas, a polícia solicitou os registros de áudio de um dispositivo Echo, alegando que poderiam conter provas do crime. Após resistir inicialmente por motivos de privacidade, a empresa acabou fornecendo os dados com o consentimento do dono do aparelho. Situação semelhante ocorreu em New Hampshire, em outro caso de homicídio.

Esses episódios reforçam que nem mesmo cláusulas internas de confidencialidade garantem a inviolabilidade dos dados quando há ordem judicial. “Uma conversa com o ChatGPT pode ser solicitada por uma autoridade judicial, assim como acontece com um e-mail ou mensagem em redes sociais”, explica o advogado Samuel Parra, especialista em direito digital, ao jornal El Confidencial.

Segundo o jurista, em países como a Espanha, o dever de colaborar com a Justiça prevalece. “Não há nenhum direito acima dos outros. Se a autoridade requer informações — mesmo que contenham dados sensíveis —, o cidadão tem que ceder, pois há outro bem jurídico protegido, como a persecução penal”, completa.

Além da questão legal, Altman também alertou para outro fenômeno preocupante: a dependência emocional dos usuários em relação ao ChatGPT. Em fala recente na Conferência da Reserva Federal dos EUA, o executivo relatou casos de jovens que afirmam não conseguir tomar decisões sem consultar o chatbot. “Ele me conhece, conhece meus amigos, faço o que ele diz… Isso me faz sentir mal”, relatou um usuário, segundo Altman.

Especialistas apontam que essa crescente intimidade com a inteligência artificial eleva o risco de exposição de dados sensíveis, que, em caso de judicialização, podem ser acessados pelas autoridades. A advertência do CEO da OpenAI expõe os limites da privacidade digital diante do avanço da tecnologia e das exigências legais em vigor.